Czy możemy naprawdę kontrolować roboty, zanim one zaczną kontrolować nas? To pytanie, które coraz częściej zadają sobie eksperci od sztucznej inteligencji i etyki.

Wprowadzenie skutecznych strategii wdrażania zasad etyki w robotyce to nie tylko kwestia technologiczna, ale przede wszystkim moralna. Musimy stworzyć system, który zapobiegnie potencjalnym zagrożeniom związanym z rozwojem AI, zanim będzie za późno.

Pamiętajmy, że przyszłość leży w naszych rękach, a etyczne ramy są fundamentem odpowiedzialnego postępu. W dzisiejszym świecie, gdzie AI staje się coraz bardziej obecna, to naprawdę nagląca sprawa.

Spójrzmy na to bliżej w poniższym artykule.

## Robotyzacja a odpowiedzialność: Jak etycznie kierować rozwojem AI? Współczesny świat pędzi naprzód w tempie, które jeszcze dekadę temu wydawało się niemożliwe.

Jednym z głównych motorów tego postępu jest sztuczna inteligencja (AI) i robotyka. Z jednej strony, mamy obietnicę automatyzacji, efektywności i rozwiązywania problemów, które dotychczas wydawały się nie do pokonania.

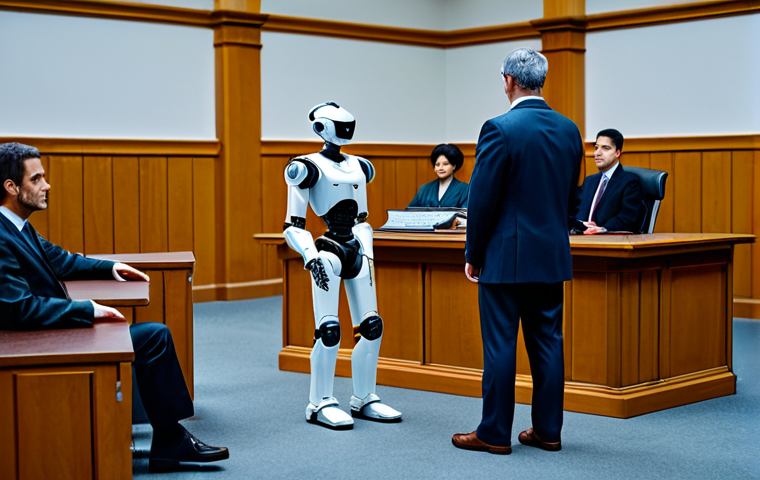

Z drugiej strony, pojawiają się pytania o etykę, bezpieczeństwo i kontrolę nad technologiami, które stają się coraz bardziej autonomiczne. Jak zatem możemy zapewnić, że rozwój AI będzie służył ludzkości, a nie stanowił dla niej zagrożenia?

To pytanie, na które musimy odpowiedzieć już teraz.

Definiowanie granic: Etyczne ramy w projektowaniu robotów

Projektując roboty i systemy AI, musimy pamiętać o wbudowaniu w nie etycznych ram. To nie tylko kwestia przestrzegania prawa, ale przede wszystkim odpowiedzialności za to, jak nasze technologie będą wpływać na społeczeństwo.

Wyobraźmy sobie robota medycznego, który podejmuje decyzje o życiu pacjenta. Jak możemy zapewnić, że jego decyzje będą zawsze sprawiedliwe i zgodne z wartościami pacjenta?

1. Transparentność algorytmów

Algorytmy, na których opierają się roboty, powinny być transparentne i zrozumiałe dla ekspertów. Pozwoli to na identyfikację potencjalnych błędów i uprzedzeń, zanim jeszcze wpłyną one na działanie robota.

2. Odpowiedzialność za decyzje

Kto ponosi odpowiedzialność, jeśli robot popełni błąd? Projektanci, programiści, operatorzy? Jasne określenie odpowiedzialności jest kluczowe dla zapewnienia, że w przypadku problemów będziemy w stanie wyciągnąć wnioski i zapobiec ich powtórzeniu.

3. Uwzględnianie wartości etycznych

Roboty powinny być programowane w taki sposób, aby uwzględniały wartości etyczne, takie jak sprawiedliwość, równość i szacunek dla ludzkiej godności. Może to wymagać stworzenia specjalnych algorytmów, które będą analizować kontekst sytuacji i podejmować decyzje zgodne z tymi wartościami.

Edukacja i świadomość: Kształtowanie etycznego podejścia do AI

Sama technologia to nie wszystko. Równie ważna jest edukacja i świadomość społeczna. Musimy uczyć ludzi o potencjalnych zagrożeniach i korzyściach związanych z AI, a także o etycznych aspektach jej rozwoju.

Im więcej ludzi będzie rozumiało te kwestie, tym łatwiej będzie nam kształtować odpowiedzialne podejście do AI.

1. Edukacja w szkołach i na uczelniach

Programy nauczania powinny obejmować zagadnienia związane z etyką AI i robotyki. Studenci powinni uczyć się o potencjalnych konsekwencjach swoich działań i o tym, jak projektować technologie, które będą służyły dobru społecznemu.

2. Kampanie społeczne

Organizowanie kampanii społecznych, które podnoszą świadomość na temat etyki AI, może pomóc w kształtowaniu opinii publicznej i promowaniu odpowiedzialnego podejścia do tej technologii.

3. Dialog z ekspertami

Organizowanie debat i konferencji, w których udział biorą eksperci z różnych dziedzin (etyki, prawa, technologii), może pomóc w identyfikacji najważniejszych wyzwań i znalezieniu najlepszych rozwiązań.

Regulacje prawne: Tworzenie ram prawnych dla robotyki i AI

Prawo odgrywa kluczową rolę w regulowaniu rozwoju AI. Musimy stworzyć ramy prawne, które będą chronić nas przed potencjalnymi zagrożeniami, a jednocześnie nie będą hamować innowacji.

To trudne zadanie, ale niezbędne dla zapewnienia, że AI będzie rozwijać się w sposób odpowiedzialny.

1. Odpowiedzialność za szkody

Prawo powinno jasno określać, kto ponosi odpowiedzialność za szkody wyrządzone przez roboty. Czy jest to producent, programista, operator, czy może sam robot (jeśli zostanie uznany za osobę prawną)?

2. Ochrona danych osobowych

Roboty często przetwarzają duże ilości danych osobowych. Prawo powinno zapewniać, że te dane są chronione przed nieuprawnionym dostępem i wykorzystaniem.

3. Regulacja autonomii

Prawo powinno regulować stopień autonomii, jaki mogą posiadać roboty. W niektórych przypadkach (np. w systemach wojskowych) autonomia powinna być ograniczona, aby zapobiec niekontrolowanym działaniom.

Przykłady zastosowania etycznych zasad w praktyce

Aby lepiej zrozumieć, jak etyczne zasady mogą być wdrażane w praktyce, przyjrzyjmy się kilku konkretnym przykładom:* Robot lekarz: Robot, który diagnozuje choroby i proponuje leczenie, powinien być programowany w taki sposób, aby uwzględniał wartości pacjenta i unikał dyskryminacji.

Powinien również być w stanie wyjaśnić swoje decyzje w sposób zrozumiały dla pacjenta. * Samochód autonomiczny: Samochód, który porusza się samodzielnie po drodze, powinien być programowany w taki sposób, aby minimalizował ryzyko wypadków i chronił życie ludzkie.

W sytuacjach, w których nie da się uniknąć wypadku, powinien podejmować decyzje, które minimalizują szkody dla wszystkich uczestników ruchu drogowego.

* Robot pracownik: Robot, który wykonuje pracę w fabryce, powinien być programowany w taki sposób, aby nie zagrażał bezpieczeństwu innych pracowników i nie przyczyniał się do utraty miejsc pracy.

Powinien również być traktowany z szacunkiem i mieć zapewnione odpowiednie warunki pracy.

Globalna współpraca: Międzynarodowe standardy etyczne dla AI

Rozwój AI to problem globalny, który wymaga globalnej współpracy. Musimy stworzyć międzynarodowe standardy etyczne, które będą obowiązywać we wszystkich krajach.

Tylko w ten sposób możemy zapewnić, że AI będzie rozwijać się w sposób odpowiedzialny i służył dobru całej ludzkości.

| Kategoria | Zasada etyczna | Opis |

|---|---|---|

| Transparentność | Zrozumiałość algorytmów | Algorytmy AI powinny być zrozumiałe dla ekspertów, aby można było identyfikować potencjalne błędy. |

| Odpowiedzialność | Jasne określenie odpowiedzialności | Należy określić, kto ponosi odpowiedzialność za błędy popełnione przez roboty. |

| Wartości etyczne | Uwzględnianie wartości | Roboty powinny być programowane w taki sposób, aby uwzględniały wartości etyczne. |

| Prywatność | Ochrona danych | Dane osobowe przetwarzane przez roboty powinny być chronione. |

| Autonomia | Regulacja autonomii | Stopień autonomii robotów powinien być regulowany prawnie. |

1. Organizacje międzynarodowe

Organizacje takie jak ONZ, UNESCO i UE powinny odgrywać kluczową rolę w tworzeniu międzynarodowych standardów etycznych dla AI.

2. Umowy międzynarodowe

Państwa powinny zawierać umowy międzynarodowe, które będą regulować rozwój AI i zapewniać, że jest on zgodny z zasadami etyki.

3. Wymiana doświadczeń

Kraje powinny wymieniać się doświadczeniami i dobrymi praktykami w zakresie etyki AI.

Przyszłość robotyki: Scenariusze i wyzwania

Przyszłość robotyki i AI jest trudna do przewidzenia. Możemy sobie wyobrazić wiele różnych scenariuszy, zarówno pozytywnych, jak i negatywnych. Kluczem do sukcesu jest odpowiedzialne podejście do rozwoju tej technologii i ciągłe monitorowanie jej wpływu na społeczeństwo.

1. Automatyzacja pracy

Automatyzacja pracy może prowadzić do wzrostu bezrobocia, ale również do poprawy jakości życia i zwiększenia produktywności.

2. Wpływ na relacje społeczne

Roboty mogą zastąpić ludzi w niektórych relacjach społecznych, co może prowadzić do izolacji i samotności.

3. Zagrożenia dla bezpieczeństwa

Roboty mogą być wykorzystywane do celów przestępczych lub wojskowych, co może stanowić poważne zagrożenie dla bezpieczeństwa.

Podsumowanie: Etyka jako kompas w świecie robotów

Rozwój robotyki i AI to ogromna szansa dla ludzkości, ale również ogromne wyzwanie. Musimy pamiętać o etyce i odpowiedzialności, aby zapewnić, że te technologie będą służyły dobru społecznemu.

To od nas zależy, czy roboty staną się naszymi sprzymierzeńcami, czy zagrożeniem. Wybór należy do nas. Pamiętajmy, że przyszłość AI kształtujemy już dziś.

Robotyzacja i sztuczna inteligencja mają ogromny potencjał, ale niosą ze sobą także poważne wyzwania etyczne. Tylko poprzez edukację, transparentność i globalną współpracę możemy zagwarantować, że rozwój tych technologii będzie służył ludzkości, a nie stanowił dla niej zagrożenia.

Pamiętajmy, że przyszłość, w której żyjemy, zależy od decyzji, które podejmujemy dzisiaj. Miejmy to na uwadze, kształtując świat, w którym technologia współgra z etyką.

Podsumowując

Rozwój AI to ogromna szansa, ale i wyzwanie. Musimy pamiętać o etyce i odpowiedzialności.

Kluczowe jest budowanie transparentnych algorytmów i jasne określanie odpowiedzialności.

Edukacja i świadomość społeczna są równie ważne co regulacje prawne.

Globalna współpraca jest niezbędna dla stworzenia międzynarodowych standardów etycznych.

Przyszłość AI zależy od decyzji, które podejmujemy dzisiaj.

Ciekawe Fakty

1. Według badań, do 2030 roku automatyzacja może wpłynąć na pracę nawet 800 milionów ludzi na całym świecie.

2. Unia Europejska pracuje nad stworzeniem kompleksowych regulacji dotyczących sztucznej inteligencji, znanych jako AI Act.

3. Etyka AI to dynamicznie rozwijająca się dziedzina, w której biorą udział eksperci z różnych dziedzin, takich jak filozofia, prawo, informatyka i socjologia.

4. Coraz więcej firm technologicznych zatrudnia etyków AI, aby pomóc im w projektowaniu i wdrażaniu odpowiedzialnych rozwiązań.

5. Organizacje non-profit, takie jak AI Now Institute, prowadzą badania nad społecznymi konsekwencjami AI i promują etyczne podejście do tej technologii.

Kluczowe Wnioski

Etyka musi być integralną częścią rozwoju AI. To fundament, na którym budujemy przyszłość.

Transparentność i odpowiedzialność są kluczowe dla budowania zaufania. Bez nich trudno mówić o etycznym rozwoju AI.

Edukacja i świadomość społeczna to podstawa. Im więcej ludzi rozumie wyzwania i możliwości związane z AI, tym lepiej.

Globalna współpraca jest niezbędna. Tylko razem możemy stworzyć standardy, które będą obowiązywać na całym świecie.

Przyszłość AI zależy od nas. To my decydujemy, czy roboty staną się naszymi sprzymierzeńcami, czy zagrożeniem.

Często Zadawane Pytania (FAQ) 📖

P: Jakie konkretne kroki można podjąć, aby zapewnić, że roboty będą działać zgodnie z zasadami etyki?

O: Osobiście uważam, że kluczowe jest wprowadzenie do robotów algorytmów, które uwzględniają wartości etyczne. Wyobraź sobie, że tworzymy specjalny “dekalog dla robotów”, który programiści muszą uwzględnić.

Dodatkowo, konieczne jest stworzenie niezależnych komisji etycznych, które będą oceniać projekty robotów i ich potencjalny wpływ na społeczeństwo. Pamiętam, jak na konferencji o AI jeden z prelegentów opowiadał o symulacjach, w których roboty uczyły się na błędach.

To brzmi obiecująco, ale musimy mieć pewność, że te błędy nie będą dotyczyły ludzkiego życia.

P: Czy istnieje ryzyko, że próby kontrolowania robotów staną się narzędziem w rękach rządów lub korporacji?

O: Ojej, to bardzo trafne pytanie! Obawiam się, że tak. Historia uczy nas, że każda technologia może być wykorzystana w dobrych i złych celach.

Musimy bardzo uważać, aby zasady etyczne nie były tylko “listkiem figowym”, który ukrywa prawdziwe intencje. Transparentność jest kluczowa. Wyobraź sobie, że każdy algorytm sterujący robotem musi być publicznie dostępny i zrozumiały dla każdego obywatela.

To trudne, ale konieczne, aby uniknąć potencjalnych nadużyć. Niedawno czytałam o przypadku w Chinach, gdzie system scoringu obywateli oparty na AI budzi poważne obawy o wolność i prywatność.

To przestroga!

P: Jak edukować społeczeństwo na temat etyki w robotyce, aby zwiększyć świadomość i odpowiedzialność?

O: No właśnie, to jest dla mnie osobiście bardzo ważne. Uważam, że edukacja powinna zaczynać się już w szkole podstawowej! Dzieci powinny uczyć się o potencjalnych zagrożeniach i korzyściach związanych z AI.

Pamiętam, jak moja siostrzenica zafascynowała się robotem humanoidalnym na targach technologicznych. Potrzebujemy więcej takich wydarzeń, ale z naciskiem na aspekty etyczne.

Dobrym pomysłem byłoby też stworzenie platformy online z darmowymi kursami i materiałami edukacyjnymi na temat etyki w robotyce. Im więcej osób będzie rozumiało, o co chodzi, tym bardziej będziemy w stanie kontrolować rozwój AI, zamiast dać się mu ponieść.

📚 Referencje

Wikipedia Encyclopedia